写在前面

深度增强学习(Deep Reinforcement Learning, DRL)是DeepMind(被谷歌收购)近几近来重点研究且发扬光大的机器学习算法框架。DQN(Deep Q-Learning Network)可谓是深度强化学习的开山之作,是将深度学习与强化学习结合起来从而实现从感知(Perception)到动作( Action )的端对端学习的一种全新的算法。DQN由DeepMind在NIPS 2013上首次发表,后又在Nature 2015上发表改进版。后续又有Double DQN,Prioritised Replay,Dueling Network等进一步改进。本篇主要通过利用DNQ玩儿飞FlappyBird的代码来理解基本的DNQ(NIPS版)、介绍DNQ的核心思想,并对后续的其他改进版本DQN做简单阐述。大部分内容整理自论文和博客。

NIPS DQN

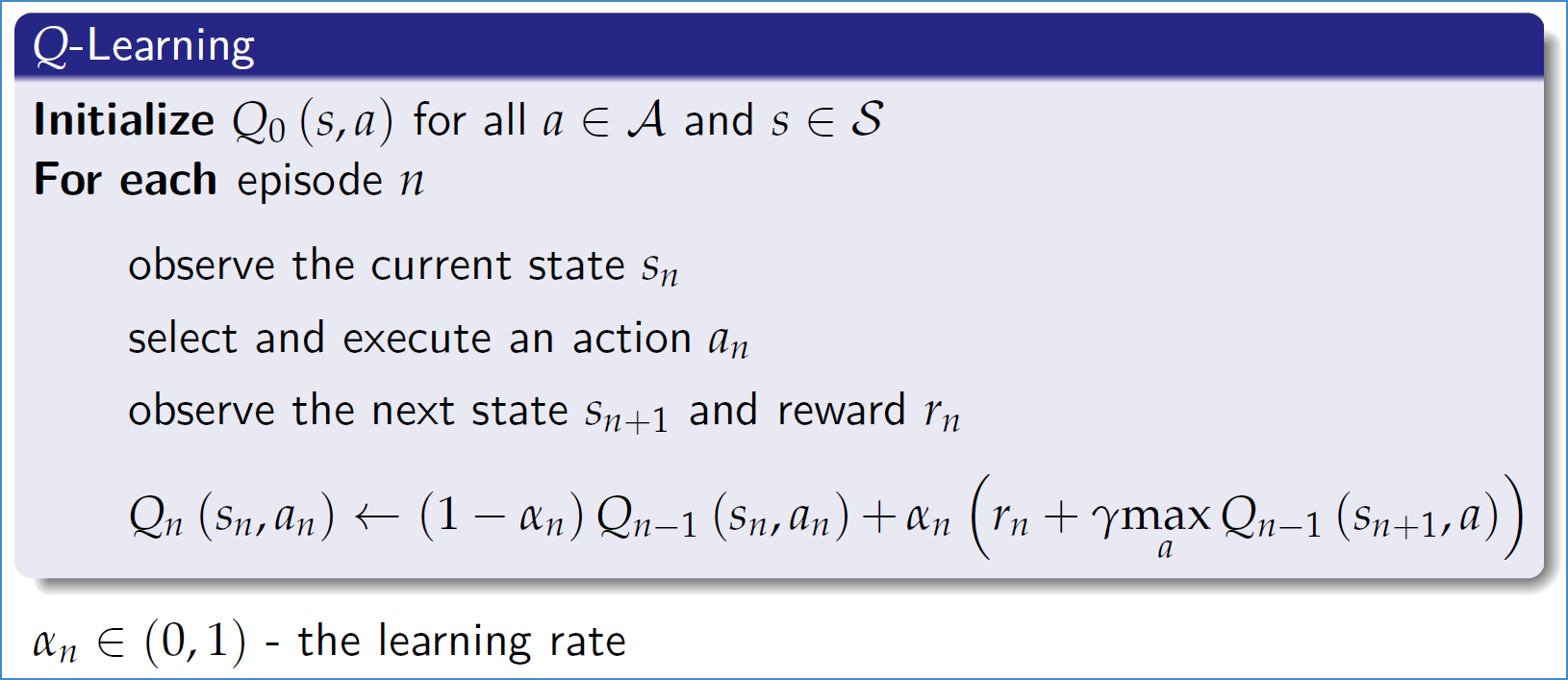

Q-Learning是一种Model-Free的强化学习算法(前文介绍的价值迭代和策略迭代属于Model-Based方法,需要已知动作对状态和回报的情况),其算法如下。

对于高维数据,建立状态-动作的Q-Table变得不切实际。解决方法就是利用价值函数近似(Value Function Approximation),通过函数来近似Q值的分布。借助深度神经网络来表示这个Q值函数就是DQN中的核心思想。举例:下面代码中的Q值函数可以看作是输入图像经过三个卷积层,一个全连接层,最后输出包含每一个动作Q值的向量。

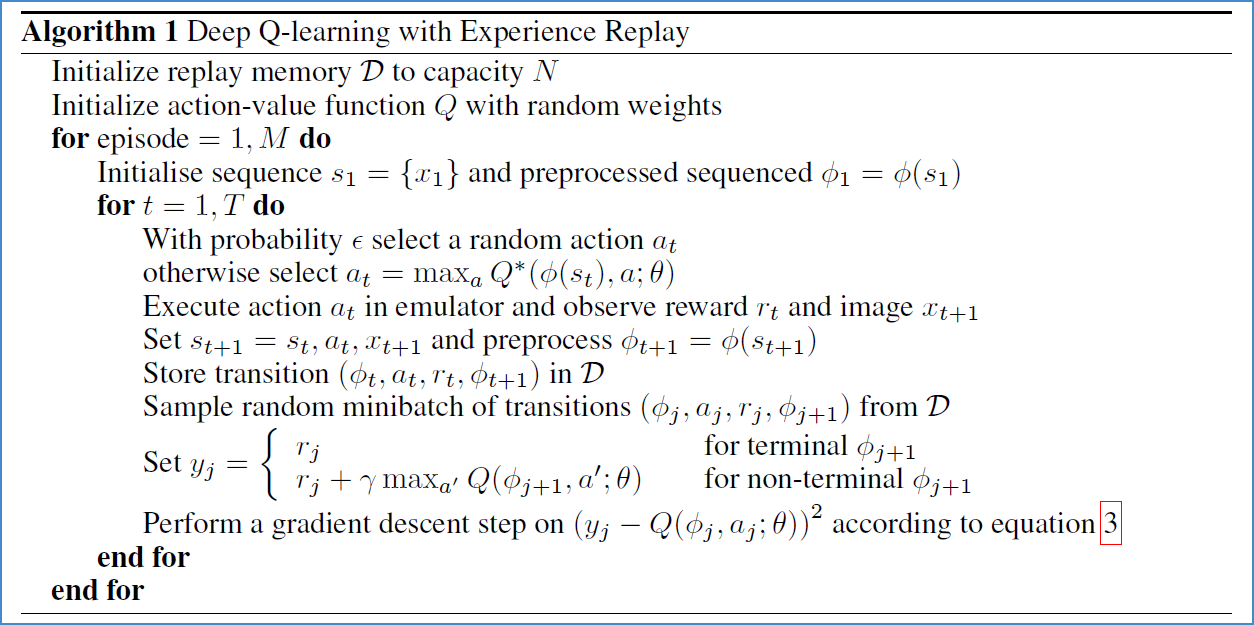

用神经网络来表示Q值不难,Q值也就是变成用Q网络(Q-Network)来表示。难的是如何训练Q网络?训练神经网络的目标一般是最优化一个损失函数,也就是标签和网络输出的偏差。DQN把目标Q值作为标签,让Q值趋近于目标Q值作为优化目标。下面是DQN具体算法。

上述算法跟Q-Learning另一个不同的地方就是经验回放(Experience Replay)部分,该机制做的事情为先进行反复试验并将这些试验步骤获取的样本存储在回放记忆(Replay Memory)中,每个样本是一个四元组(当前状态、当前状态动作的Q值,当前采取动作获得的即时回报,下一个状态动作的Q值)。训练时通过经验回放机制对存储下来的样本进行随机采样,在一定程度上能够去除样本之间的相关性,从而更容易收敛。该机制的弊端是训练的时候是离线的形式,无法做到在线形式。

下面是利用DQN玩FlappyBird的核心代码和注释。完整代码可来这里下载。

# File: FlappyBirdDQN.py

import cv2

import wrapped_flappy_bird as game

from BrainDQN_Nature import BrainDQN

import numpy as np

import sys

sys.path.append("game/")

# 辅助函数:将80*80大小的图像进行灰度二值化处理

def preprocess(observation):

observation = cv2.cvtColor(cv2.resize(observation, (80, 80)), cv2.COLOR_BGR2GRAY)

ret, observation = cv2.threshold(observation,1,255,cv2.THRESH_BINARY)

return np.reshape(observation,(80,80,1))

# 主函数:初始化DQN和游戏,并开始游戏进行训练

def playFlappyBird():

# Step 1: 初始化BrainDQN

actions = 2

brain = BrainDQN(actions)

# Step 2: 初始化Flappy Bird游戏

flappyBird = game.GameState()

# Step 3: 开始游戏

# Step 3.1: 得到初始状态

action0 = np.array([1,0])

observation0, reward0, terminal = flappyBird.frame_step(action0)

observation0 = cv2.cvtColor(cv2.resize(observation0, (80, 80)), cv2.COLOR_BGR2GRAY)

ret, observation0 = cv2.threshold(observation0,1,255,cv2.THRESH_BINARY)

brain.setInitState(observation0)

# Step 3.2: 开始游戏

while 1!= 0:

# 得到一个动作

action = brain.getAction()

# 通过游戏接口得到动作后返回的下一帧图像、回报和终止标志

nextObservation,reward,terminal = flappyBird.frame_step(action)

# 图像灰度二值化处理

nextObservation = preprocess(nextObservation)

# 将动作后得到的下一帧图像放入到新状态newState,然后将新状态、当前状态、动作、回报和终止标志放入都游戏回放记忆序列

brain.setPerception(nextObservation,action,reward,terminal)

def main():

playFlappyBird()

if __name__ == '__main__':

main()

# File: BrainDQN_NIPS.py

import tensorflow as tf

import numpy as np

import random

from collections import deque

# 超参数

FRAME_PER_ACTION = 1

GAMMA = 0.99 # decay rate of past observations

OBSERVE = 100. # timesteps to observe before training

EXPLORE = 150000. # frames over which to anneal epsilon

FINAL_EPSILON = 0.0 # final value of epsilon

INITIAL_EPSILON = 0.9 # starting value of epsilon

REPLAY_MEMORY = 50000 # number of previous transitions to remember

BATCH_SIZE = 32 # size of minibatch

class BrainDQN:

# 初始化函数

def __init__(self,actions):

# 初始化回放记忆队列

self.replayMemory = deque()

# 初始化一些参数

self.timeStep = 0

self.epsilon = INITIAL_EPSILON

self.actions = actions

# 初始化Q网络

self.createQNetwork()

# 创建Q深度神经网络

def createQNetwork(self):

# 网络权值

W_conv1 = self.weight_variable([8,8,4,32])

b_conv1 = self.bias_variable([32])

W_conv2 = self.weight_variable([4,4,32,64])

b_conv2 = self.bias_variable([64])

W_conv3 = self.weight_variable([3,3,64,64])

b_conv3 = self.bias_variable([64])

W_fc1 = self.weight_variable([1600,512])

b_fc1 = self.bias_variable([512])

W_fc2 = self.weight_variable([512,self.actions])

b_fc2 = self.bias_variable([self.actions])

# 输入层

self.stateInput = tf.placeholder("float",[None,80,80,4])

# 隐层

h_conv1 = tf.nn.relu(self.conv2d(self.stateInput,W_conv1,4) + b_conv1)

h_pool1 = self.max_pool_2x2(h_conv1)

h_conv2 = tf.nn.relu(self.conv2d(h_pool1,W_conv2,2) + b_conv2)

h_conv3 = tf.nn.relu(self.conv2d(h_conv2,W_conv3,1) + b_conv3)

h_conv3_flat = tf.reshape(h_conv3,[-1,1600])

h_fc1 = tf.nn.relu(tf.matmul(h_conv3_flat,W_fc1) + b_fc1)

# Q值层

self.QValue = tf.matmul(h_fc1,W_fc2) + b_fc2

# 训练配置

self.actionInput = tf.placeholder("float",[None,self.actions])

self.yInput = tf.placeholder("float", [None])

Q_action = tf.reduce_sum(tf.mul(self.QValue, self.actionInput), reduction_indices = 1)

self.cost = tf.reduce_mean(tf.square(self.yInput - Q_action))

self.trainStep = tf.train.AdamOptimizer(1e-6).minimize(self.cost)

# 保持与加载网络

self.saver = tf.train.Saver()

self.session = tf.InteractiveSession()

self.session.run(tf.initialize_all_variables())

checkpoint = tf.train.get_checkpoint_state("saved_networks")

if checkpoint and checkpoint.model_checkpoint_path:

self.saver.restore(self.session, checkpoint.model_checkpoint_path)

print ("Successfully loaded:", checkpoint.model_checkpoint_path)

else:

print ("Could not find old network weights")

# 训练Q网络

def trainQNetwork(self):

# Step 1: 从回放记忆中随机抽取小批量数据

minibatch = random.sample(self.replayMemory,BATCH_SIZE)

state_batch = [data[0] for data in minibatch]

action_batch = [data[1] for data in minibatch]

reward_batch = [data[2] for data in minibatch]

nextState_batch = [data[3] for data in minibatch]

# Step 2: 计算y

y_batch = []

QValue_batch = self.QValue.eval(feed_dict={self.stateInput:nextState_batch})

for i in range(0,BATCH_SIZE):

terminal = minibatch[i][4]

if terminal:

y_batch.append(reward_batch[i])

else:

y_batch.append(reward_batch[i] + GAMMA * np.max(QValue_batch[i]))

# Step 3: 训练

self.trainStep.run(feed_dict={

self.yInput : y_batch,

self.actionInput : action_batch,

self.stateInput : state_batch

})

# 每10000次迭代保存一次网络

if self.timeStep % 10000 == 0:

self.saver.save(self.session, 'saved_networks/' + 'network' + '-dqn', global_step = self.timeStep)

# 更新回放记忆序列,当回放数据足够时调用trainQNetwork进行训练

def setPerception(self,nextObservation,action,reward,terminal):

newState = np.append(self.currentState[:,:,1:],nextObservation,axis = 2)

self.replayMemory.append((self.currentState,action,reward,newState,terminal))

if len(self.replayMemory) > REPLAY_MEMORY:

self.replayMemory.popleft()

if self.timeStep > OBSERVE:

self.trainQNetwork() # 训练网络

self.currentState = newState

self.timeStep += 1

# 得到动作

def getAction(self):

QValue = self.QValue.eval(feed_dict= {self.stateInput:[self.currentState]})[0]

action = np.zeros(self.actions)

action_index = 0

if self.timeStep % FRAME_PER_ACTION == 0:

if random.random() <= self.epsilon:

action_index = random.randrange(self.actions)

action[action_index] = 1

else:

action_index = np.argmax(QValue)

action[action_index] = 1

else:

action[0] = 1

if self.epsilon > FINAL_EPSILON and self.timeStep > OBSERVE:

self.epsilon -= (INITIAL_EPSILON - FINAL_EPSILON)/EXPLORE

return action

# 设置初始状态

def setInitState(self,observation):

self.currentState = np.stack((observation, observation, observation, observation), axis = 2)

# 辅助函数,用于生成网络权值

def weight_variable(self,shape):

initial = tf.truncated_normal(shape, stddev = 0.01)

return tf.Variable(initial)

# 辅助函数,用于生成网络bias

def bias_variable(self,shape):

initial = tf.constant(0.01, shape = shape)

return tf.Variable(initial)

# 辅助函数,2D卷积

def conv2d(self,x, W, stride):

return tf.nn.conv2d(x, W, strides = [1, stride, stride, 1], padding = "SAME")

# 辅助函数,2*2 max pooling

def max_pool_2x2(self,x):

return tf.nn.max_pool(x, ksize = [1, 2, 2, 1], strides = [1, 2, 2, 1], padding = "SAME")

Nature DQN

NIPS DQN在基本的DQN算法基础上使用了经验回放,通过将训练得到的数据储存起来然后随机采样的方法降低了数据样本的相关性,提升了性能。接下来,Nature DQN做了一个改进,就是增加Target Q网络。也就是我们在计算目标Q值时使用专门的一个目标Q网络来计算,而不是直接使用预更新的Q网络。这样做的目的是为了减少目标计算与当前值的相关性,相应的损失函数如下:

$$I=(r+\gamma \max{Q(s',a',w^{-})-Q(s,a,w)})^2$$

如上面损失函数公式所示,计算目标Q值的网络使用参数$w^{-}$而不是$w$。原来NIPS版本的DQN目标Q网络是动态变化的,跟着Q网络的更新而变化,这样不利于计算目标Q值,导致目标Q值和当前的Q值相关性较大。因此提出单独使用一个目标Q网络。那么目标Q网络的参数如何来呢?还是从Q网络中来,只不过是延迟更新。也就是每次等训练了一段时间再将当前Q网络的参数值复制给目标Q网络。

其他改进版

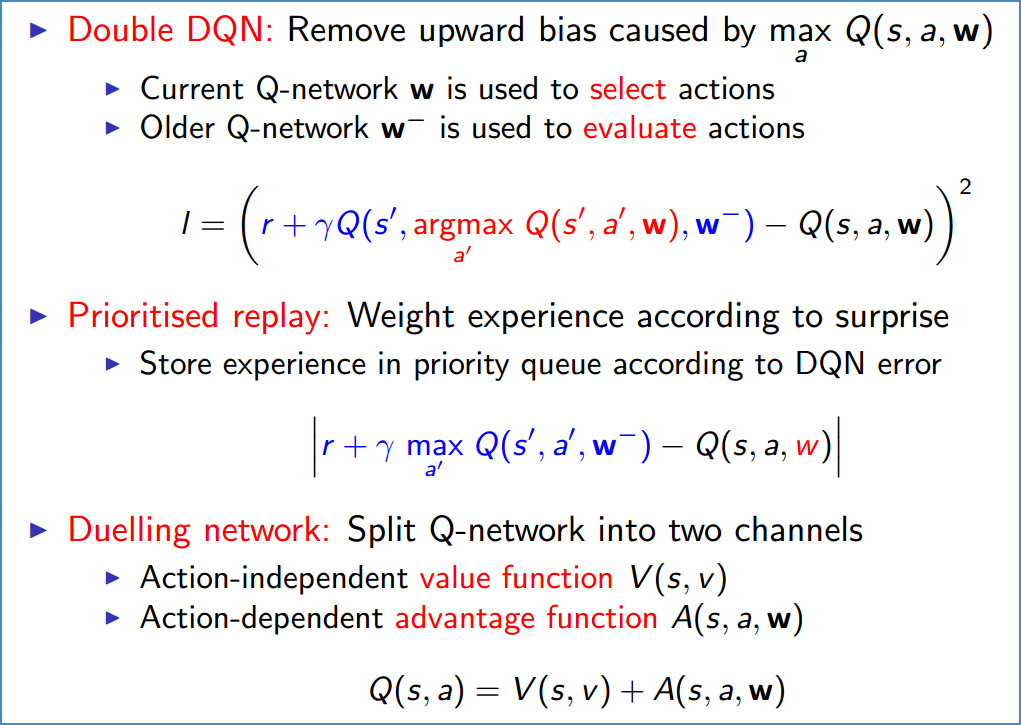

Double DQN,Prioritised Replay还有Dueling Network是对DQN改进显著的三大方法,主要改进如下图所示。

Double DQN:目的是减少因为Max Q值计算带来的计算偏差,或者称为过度估计(Over Estimation)问题,用当前的Q网络来选择动作,用目标Q网络来计算目标Q。

Prioritised Replay:也就是优先经验的意思。优先级采用目标Q值与当前Q值的差值来表示。优先级高,那么采样的概率就高。

Dueling Network:将Q网络分成两个通道,一个输出V,一个输出A,最后再合起来得到Q。如下图所示(引用自Dueling Network论文)。这个方法主要是Idea很简单但是很难想到,然后效果一级棒,因此也成为了ICML的Best Paper。

参考文献

[1] Mnih, Volodymyr, et al. "Playing atari with deep reinforcement learning." NIPS2013

[2] Mnih, Volodymyr, et al. "Human-level control through deep reinforcement learning." Nature2015

[4] Schaul, Tom, et al. "Prioritized experience replay." ICLR2016

[5] Wang, Ziyu, et al. "Dueling network architectures for deep reinforcement learning." ICML2016

[6] DQN的各种改进

[7] 深度解读DQN算法